SK하이닉스가 지난해부터 양산하고 있는 HBM3/사진제공=SK하이닉스

SK하이닉스가 지난해부터 양산하고 있는 HBM3/사진제공=SK하이닉스엔비디아는 챗GPT와 같은 생성형 인공지능(AI) 구동 필수품인 고성능 그래픽처리장치(GPU)를 만드는데, HBM은 GPU에 필수불가결한 솔루션이다.

HBM이 GPU와 결합해 쓰이는만큼, 성능 평가는 출시 전 필수적인 과정이다. 메모리반도체 제조사로선 고객사들에게 기술력을 입증하는 중요 관문이기도 하다. SK하이닉스가 이를 통과할 경우 4세대인 HBM3를 엔비디아에 공급한 것에 이어 연달아 5세대 HBM3E까지 엔비디아에 납품하게 된다.

AI반도체 시장에 사용되는 엔비디아의 GPU 점유율은 90%가 넘는다. H100은 가장 최신 규격으로, 최근 물량 주문이 쏟아지는 것으로 전해진다. 챗GPT 개발사인 오픈AI가 최근 출시한 대규모 언어모델(LLM) 'GPT-4'에도 엔비디아의 H100 칩이 1만여개 들어갔다. AI열풍에 엔비디아는 지난달 30일 반도체 기업으로서는 사상 처음으로 시가총액 1조달러를 달성하기도 했다.

이 시각 인기 뉴스

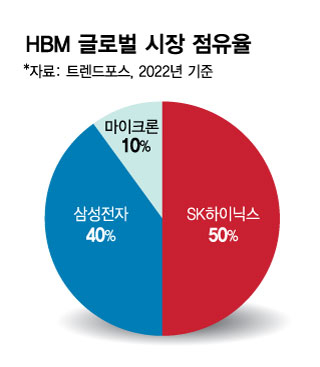

이 때문에 지난해 하반기부터 불황 직격탄을 맞은 국내 메모리반도체 업체로서도 HBM은 놓칠 수 없는 시장이다. 고부가가치, 고수익 제품으로 수익성을 꾀해야 하기 때문이다. HBM의 가격은 일반 D램보다 2~3배 높은데, AI 반도체 열풍이 불면서 최근엔 5배까지 오르기도 했다. 현재로선 D램 시장에서 차지하는 비중이 적지만 성장 가능성은 크다. 트렌드포스는 HBM 시장 규모가 올해부터 2025년까지 연평균 최대 45% 이상 성장할 것이라고 봤다.

삼성전자도 올해 하반기 고성능 HBM을 내놓을 예정이다. 김재준 삼성전자 메모리사업부 부사장은 4월 1분기 실적 발표 후 진행한 컨퍼런스 콜에서 "시장이 요구하는 높은 성능과 용량을 갖춘 차세대 HBM3P 제품을 하반기 출시할 것"이라고 밝혔다. 삼성전자는 2021년 HBM-PIM(프로세싱 인 메모리)을 세계 최초로 개발했다. PIM기술을 통해 메모리반도체가 데이터 저장에서 더 나아가 프로그램 연산까지 처리할 수 있도록 했다.

시장조사업체 가트너는 AI반도체 시장 규모가 올해 553억달러, 2026년엔 861억달러 규모에 이를 것이라고 내다봤다.