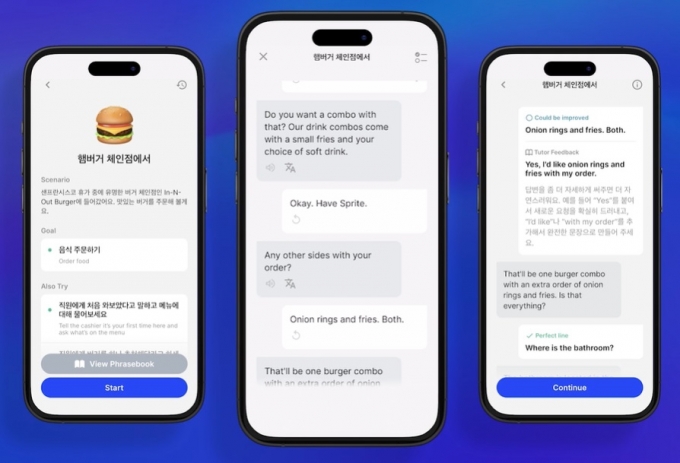

스픽 앱에 위스퍼 API가 적용된 모습/사진=오픈AI

스픽 앱에 위스퍼 API가 적용된 모습/사진=오픈AI2일(현지시각) 오픈AI는 음성-텍스트 변환모델인 '위스퍼'(Whisper) API를 공개했다.

위스퍼 API는 분당 0.006달러로, 다양한 파일형식(m4a·mp3·mp4·mpeg·mpga·wav·webm)을 지원한다. 오픈AI는 "지난해 9월 공개된 위스퍼는 개발자 커뮤니티로부터 찬사를 받았지만 실행하기 어려운 모델이었다"라며 "이젠 API를 통해 위스퍼 large-v2 모델을 사용할 수 있게 됐다. 최적화된 스택으로 다른 서비스 대비 빠른 서비스를 보장한다"고 강조했다.

챗GPT 비용, 10분의 1로 저렴해진다오픈AI는 챗GPT API 'GPT-3.5 터보'도 출시했다. 이는 기존 챗GPT에 사용된 초거대 AI 'GPT-3.5'와 동일한 모델이지만 비용은 1000토큰당 0.002달러로 기존대비 10분의 1로 저렴하다.

이에 따라 AI 콜센터도 확산될 전망이다. 이미 글로벌 전자상거래 기업 쇼피파이는 자체 쇼핑 어시스턴트 서비스에 챗GPT를 적용했다. '따뜻한 우드 찾아줘'라고 입력하면 그에 맞는 상품을 추천해주는 서비스인데, 앞으로는 문자가 아니라 간단히 말만 하면 될 전망이다.

이 시각 인기 뉴스

영어 회화 앱 스픽(Speak)도 위스퍼 API를 적용한 교육서비스를 선보였다. 예를들어 햄버거 가게에서 음식을 주문하는 상황에서 영어로 말하면 AI가 이를 인식하고 그에 맞는 답을 해준다. 오픈AI는 "스픽은 한국에서 가장 빠르게 성장하고 있는 영어 앱"이라며 "모든 레벨의 언어 학습자에게 인간 수준의 정확도를 제공하는 위스퍼는 개방형 대화연습과 정확한 피드백을 제공한다"고 설명했다.