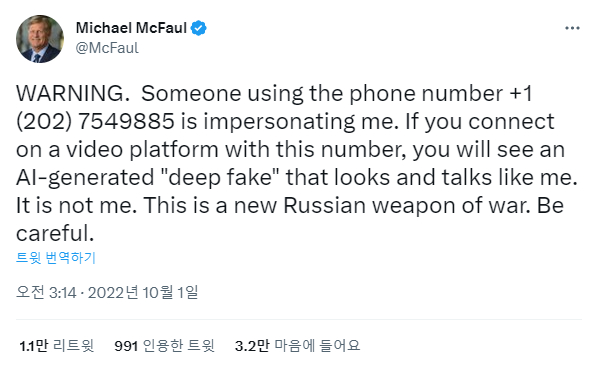

전직 주 러시아 미국 대사를 지낸 마이클 맥폴이 지난해 자신의 트위터 계정을 통해 자신을 흉내낸 딥페이크물에 주의할 것을 당부하는 글을 올렸다. 맥폴 전 대사는 해당 딥페이크에 대해 "러시아의 새로운 전쟁 무기"라고 주장했다. 사진은 트위터 게시물 캡쳐.

전직 주 러시아 미국 대사를 지낸 마이클 맥폴이 지난해 자신의 트위터 계정을 통해 자신을 흉내낸 딥페이크물에 주의할 것을 당부하는 글을 올렸다. 맥폴 전 대사는 해당 딥페이크에 대해 "러시아의 새로운 전쟁 무기"라고 주장했다. 사진은 트위터 게시물 캡쳐. 딥페이크는 '딥러닝(심층학습)'과 '가짜(Fake)'를 합성한 용어다. 인공지능(AI)의 딥러닝을 활용해 사진·영상·음성을 도용하거나 복제하는 기술을 일컫는다. 3~4년 전만 해도 인간형 AI나 딥보이스 모델을 제작하려면 몇 시간 분량의 녹화와 녹음자료가 필요했지만 이제는 사진 1장으로도 그 사람인 것처럼 움직이는 영상을 만들 수 있다.

독일 마이헤리티지의 딥페이크 기술을 활용해 네티즌들이 제작한 유관순 열사, 안중근 의사, 윤봉길 의사 등 순국선열의 딥페이크 영상.

독일 마이헤리티지의 딥페이크 기술을 활용해 네티즌들이 제작한 유관순 열사, 안중근 의사, 윤봉길 의사 등 순국선열의 딥페이크 영상.

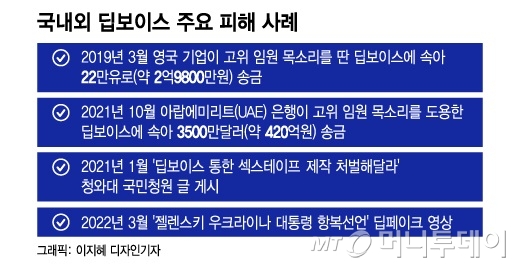

관련업계에 따르면 2019년 3월 영국의 한 기업이 고위 임원 목소리를 도용한 딥보이스에 속아 22만유로(약 2억9800만원)을 잘못 송금한 사건을 비롯해 △중국 국세청 안면인식 시스템을 딥페이크로 속여 세금 875억원을 탈루한 사례(2021년 3월) △UAE(아랍에미리트) 은행이 기업 임원의 목소리를 도용한 딥보이스에 속아 3500만달러(약 420억원)를 송금한 사례(2021년 10월) 등이 유명한 금융 딥페이크 범죄로 꼽힌다.

이 시각 인기 뉴스

정치·외교·안보 등 민감한 영역에서 허위정보 유포가 문제되는 경우도 있다. 2018년 도널드 트럼프 당시 미국 대통령을 비속어로 평가절하하는 버락 오바마 전 대통령의 딥페이크 동영상이 온라인에 퍼졌다. 기업 보안도 위협을 받을 수 있다. 지난해 6월 미국 FBI(연방수사국)는 도용한 개인식별정보 등으로 딥페이크를 만들어 재택·원격근무를 운영하는 기업에 취직하려는 시도가 다수 발견됐으니 주의하라는 공문을 배포했다.

일본에서는 쇼핑몰, 여행사, 학원 등의 이용후기에 딥페이크를 사용해 가짜 얼굴 사진 등으로 후기를 작성, 평판을 조작한 사건도 보고됐다. 딥페이크가 이미 일상에 깊숙하게 침투했다는 얘기다.

"새로운 유형의 범죄"…디지털지문 도입·처벌 강화 필요

처벌을 강화해야 한다는 주장도 있다. 김명주 서울여대 바른AI연구센터장 겸 정보보호학과 교수는 "가족끼리 통화할 때도 상대방이 AI로 만들어진 가짜 인간인지 의심해 봐야 하는 시대가 됐다"며 "딥페이크 악용 범죄를 가중처벌하는 등 조치가 필요하다"고 밝혔다.

김 교수는 "N번방 사건으로 딥페이크 음란물에 대한 처벌규정만 강화됐을 뿐 다른 유형의 딥페이크 악용에 대한 방지책은 없다"며 "AI로 만든 딥페이크물에 '이 생성물은 딥페이크물'이라는 표시조항을 넣도록 강제한 미국의 딥페이크지법도 참조할 필요가 있다"고 말했다.

최경진 학회장 역시 "딥페이크를 악용해 타인의 생명·신체·재산에 위해를 가하는 행위를 새로운 범죄 유형으로 정할 수도 있을 것"이라며 "'딥페이크 이용 명의도용죄' 등을 새로운 범죄 유형으로 추가할지도 공론화해야 한다"고 말했다.